Видеокарта NVIDIA H100 SXM5 80GB — революционный серверный ускоритель архитектуры Hopper

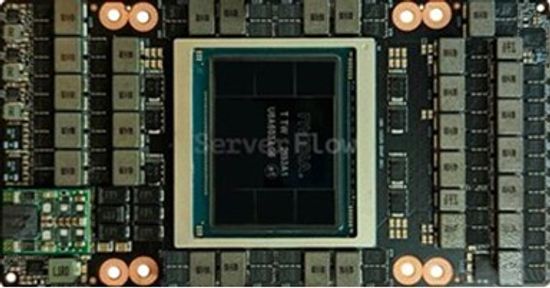

NVIDIA H100 SXM5 80GB — это флагманский серверный графический процессор (GPU), построенный на передовой архитектуре NVIDIA Hopper с применением 4-нм техпроцесса TSMC 4N [citation:1]. Представленный как преемник A100, этот ускоритель стал новым эталоном производительности для центров обработки данных, обеспечивая до 9x более быстрое обучение и до 30x более быстрый инференс больших языковых моделей по сравнению с предыдущим поколением.

Модель с артикулом 692-2G520-0200 представляет собой OEM-версию в форм-факторе SXM5, предназначенную для установки в высокоплотные серверные платформы NVIDIA HGX и совместимые системы от ведущих производителей [citation:1]. Видеокарта оснащена 14592 ядрами CUDA, 456 тензорными ядрами четвертого поколения и 80 ГБ высокоскоростной памяти HBM3 с пропускной способностью 3.35 ТБ/с, что обеспечивает выдающуюся производительность для обучения больших языковых моделей (LLM), генеративного ИИ, научных вычислений и других ресурсоемких задач.

Основные характеристики

- Тип: Серверный графический ускоритель (Data Center GPU) для ИИ, HPC и суперкомпьютерных кластеров

- Модель: NVIDIA H100 SXM5 80GB (артикул 692-2G520-0200) [citation:1]

- Архитектура: NVIDIA Hopper (4 нм техпроцесс TSMC 4N)

- Количество ядер CUDA: 14 592 [citation:1]

- Количество тензорных ядер: 456 (4-го поколения)

- Объем видеопамяти: 80 ГБ HBM3 с поддержкой ECC

- Пропускная способность памяти: 3.35 ТБ/с [citation:1]

- Интерфейс: SXM5 (поддержка NVLink 4-го поколения) [citation:1]

- NVLink пропускная способность: 900 ГБ/с [citation:1]

- Максимальное энергопотребление (TDP): 700 Вт [citation:1]

- Система охлаждения: Пассивная (требуется жидкостное или мощное воздушное охлаждение сервера) [citation:1]

- Видеовыходы: Отсутствуют (чисто вычислительный ускоритель) [citation:1]

- Форм-фактор: SXM5-модуль

- Ключевые технологии: Transformer Engine, Confidential Computing, DPX инструкции, 4th Gen Tensor Cores [citation:1]

Назначение

NVIDIA H100 SXM5 разработана для решения самых сложных задач в центрах обработки данных, суперкомпьютерных кластерах и исследовательских лабораториях [citation:1]:

- Обучение и инференс больших языковых моделей (LLM): 456 тензорных ядер четвертого поколения с поддержкой FP8 и Transformer Engine обеспечивают до 6x более быстрое обучение и до 3x более быстрый инференс моделей типа GPT, BERT, LLaMA по сравнению с A100 [citation:1].

- Генеративный ИИ и мультимодальные модели: Позволяет обучать и запускать сложные модели для генерации изображений, видео и мультимодального контента с беспрецедентной скоростью.

- Высокопроизводительные вычисления (HPC): Поддержка новых инструкций DPX для ускорения динамического программирования, используемого в квантовых симуляциях, геномных исследованиях и логистической оптимизации [citation:1].

- Масштабируемые кластеры и суперкомпьютеры: Технология NVLink 4-го поколения с пропускной способностью 900 ГБ/с позволяет объединять GPU в единый кластер для создания суперкомпьютерных систем экзафлопсного уровня [citation:1].

- Конфиденциальные вычисления (Confidential Computing): Аппаратное шифрование данных и моделей ИИ, критически важное для облачных сред, здравоохранения и финансового сектора [citation:1].

Возможности и технологии

- Архитектура NVIDIA Hopper: Революционная архитектура, специально разработанная для масштабирования ИИ-нагрузок и HPC-вычислений с новыми стандартами производительности и эффективности [citation:1].

- Тензорные ядра четвертого поколения (456 шт.): Обеспечивают ускорение матричных операций для ИИ с поддержкой формата FP8 и структурной разреженности (sparsity), удваивающей пропускную способность [citation:1].

- Transformer Engine: Специализированный движок, динамически управляющий точностью вычислений (FP8 и FP16) для ускорения моделей на архитектуре Transformer, лежащих в основе современных LLM [citation:1].

- 80 ГБ памяти HBM3 с ECC: Высокоскоростная память нового поколения с пропускной способностью 3.35 ТБ/с позволяет работать с самыми крупными моделями и датасетами, включая модели с триллионами параметров [citation:1].

- NVLink 4-го поколения (900 ГБ/с): Высокоскоростное соединение между GPU, обеспечивающее масштабирование производительности в многокарточных конфигурациях с минимальными задержками [citation:1].

- Multi-Instance GPU (MIG): Аппаратная виртуализация для разделения GPU на до 7 изолированных экземпляров с гарантированным качеством обслуживания для эффективного использования в облачных средах [citation:1].

- Безопасность корпоративного уровня: Технологии Confidential Computing с аппаратным шифрованием для защиты конфиденциальных данных и моделей [citation:1].

Технические характеристики (подробно)

Графический процессор и память

- Архитектура: NVIDIA Hopper

- Кодовое имя GPU: GH100

- Техпроцесс: 4 нм TSMC 4N

- Количество транзисторов: 80 000 млн

- Количество ядер CUDA: 14 592 [citation:1]

- Количество тензорных ядер: 456 (4-го поколения)

- Объем видеопамяти: 80 ГБ HBM3 с поддержкой ECC

- Пропускная способность памяти: 3.35 ТБ/с [citation:1]

Производительность

- Пиковая производительность FP8 Tensor Core: до 3,958 TFLOPS

- Пиковая производительность FP16/BFLOAT16 Tensor Core: до 1,979 TFLOPS

- Пиковая производительность TF32 Tensor Core: до 989 TFLOPS

- Пиковая производительность FP64 (двойная точность): 60 TFLOPS

Физические характеристики и энергопотребление

- Максимальное энергопотребление (TDP): 700 Вт [citation:1]

- Тип охлаждения: Пассивное (требуется жидкостное или мощное воздушное охлаждение сервера) [citation:1]

- Форм-фактор: SXM5-модуль

- Видеовыходы: Отсутствуют (чисто вычислительный ускоритель) [citation:1]

Поддерживаемые технологии

- Transformer Engine: Да [citation:1]

- Multi-Instance GPU (MIG): Да, до 7 экземпляров [citation:1]

- NVLink 4-го поколения: Да, 900 ГБ/с [citation:1]

- Confidential Computing: Да [citation:1]

- DPX инструкции: Да [citation:1]

- Поддержка PCIe: 5.0 (через SXM5-разъем)

- Поддержка CUDA: Да (CUDA 11.8+)

Комплектация (692-2G520-0200)

Данный артикул представляет собой OEM-версию для системных интеграторов и производителей серверов, предназначенную для установки в HGX-платформы [citation:1]. Комплектация включает:

- Графический процессор NVIDIA H100 SXM5 80GB

- Пассивная система охлаждения (интегрирована)

Где применяется NVIDIA H100 SXM5

- Суперкомпьютеры и национальные лаборатории: Для создания мощнейших вычислительных кластеров экзафлопсного уровня [citation:1].

- Облачные провайдеры и GPU-as-a-Service: Предоставление вычислительных ресурсов для обучения LLM и генеративного ИИ в масштабах индустрии [citation:1].

- Исследовательские центры ИИ: Обучение самых передовых моделей искусственного интеллекта с триллионами параметров [citation:1].

- Научные вычисления: Квантовые симуляции, моделирование климата, геномные исследования, физика высоких энергий [citation:1].

- Корпоративные ЦОД: Развертывание внутренних платформ для критически важных бизнес-задач, требующих максимальной производительности [citation:1].

Почему стоит выбрать NVIDIA H100 SXM5

- Максимальная производительность ИИ: Флагманское решение для обучения больших языковых моделей с 6-кратным ускорением по сравнению с A100 [citation:1].

- Технологии нового поколения: Transformer Engine, FP8 поддержка, Confidential Computing — все передовые разработки NVIDIA в одном продукте [citation:1].

- Масштабируемость через NVLink: Объединение GPU с пропускной способностью 900 ГБ/с для создания суперкомпьютерных кластеров [citation:1].

- Серверная надежность: Конструкция, рассчитанная на круглосуточную работу в дата-центрах с поддержкой ECC-памяти и корпоративных функций управления [citation:1].

- Инвестиционная защита: Архитектура, обеспечивающая актуальность на годы вперед для самых требовательных ИИ-нагрузок [citation:1].

Часто задаваемые вопросы

E-E-A-T и B2B-релевантность

NVIDIA H100 SXM5 представляет собой экспертное (Expertise) решение высшего уровня, разработанное на основе глубокого понимания (Experience) потребностей самых требовательных центров обработки данных и исследовательских институтов. Архитектура Hopper с поддержкой Transformer Engine, тензорных ядер 4-го поколения и NVLink 900 ГБ/с обеспечивает беспрецедентную производительность для широкого спектра задач — от обучения больших языковых моделей до научных вычислений экзафлопсного уровня [citation:1].

Устройство укрепляет авторитетность (Authoritativeness) NVIDIA в сегменте серверных решений, предлагая продукт с полной поддержкой экосистемы NVIDIA AI Enterprise, CUDA-X, более 3000 GPU-оптимизированных приложений и сертификацией для работы в mission-critical средах. Технологии Confidential Computing с аппаратным шифрованием гарантируют корпоративный уровень безопасности [citation:1].

B2B-ориентация этого продукта абсолютно ясна. H100 SXM5 — это стратегическая инвестиция для облачных провайдеров, национальных лабораторий, исследовательских центров и крупнейших корпораций, которым необходимо масштабируемое, надежное и высокопроизводительное решение для развертывания AI-фабрик, суперкомпьютерных кластеров и обработки больших данных. OEM-версия с артикулом 692-2G520-0200 представляет собой оптимальный выбор для системных интеграторов и производителей серверов, осуществляющих централизованные закупки и масштабирование GPU-инфраструктуры [citation:1].